Yüz tanıma araçları, CCTV veya video görüntülerinin yanı sıra görüntülerdeki belirli kişileri tanımlayabilen hesaplamalı modellerdir. Bu araçlar halihazırda çok çeşitli gerçek dünya ortamlarında kullanılmaktadır; örneğin, kolluk kuvvetlerine ve sınır kontrol görevlilerine ceza soruşturmalarında ve gözetleme çabalarında ve kimlik doğrulama ve biyometrik uygulamalarda yardımcı olmaktadır. Mevcut modellerin çoğu oldukça iyi performans gösterse de, iyileştirme için hala çok yer olabilir.

Londra Queen Mary Üniversitesi'ndeki araştırmacılar yakın zamanda yüz tanıma için yeni ve gelecek vaat eden bir mimari yarattılar. arXiv'de önceden yayınlanan bir makalede sunulan bu mimari, şimdiye kadar önerilenlerin çoğundan farklı olarak görüntülerden yüz özelliklerini çıkarma stratejisine dayanıyor .

Çalışmayı yürüten iki araştırmacı Zhonglin Sun ve Georgios Tzimiropoulos, TechXplore'a "Evrişimli sinir ağları (CNN'ler) ve marj tabanlı kayıplar kullanan bütünsel yöntemler , yüz tanıma araştırmalarına hakim oldu."

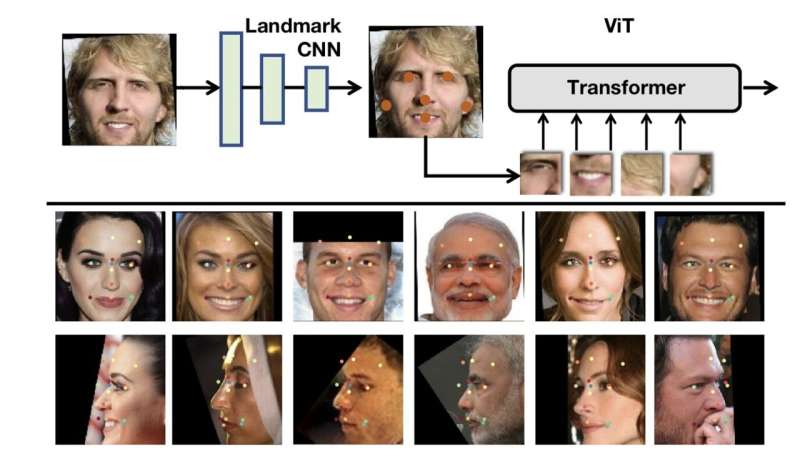

"Bu çalışmada, bu ayardan iki şekilde ayrıldık: (a) yüz tanıma için çok güçlü bir temeli eğitmek için bir mimari olarak Vision Transformer'ı kullanıyoruz, basitçe fViT olarak adlandırılır ve halihazırda en gelişmiş teknolojilerin çoğunu geride bırakır. (b) İkinci olarak, parça tabanlı yüz tanıma yöntemlerini anımsatan yüz tanıma için bir boru hattı tasarlamak üzere düzensiz ızgaralardan çıkarılan bilgileri (görsel belirteçler) işlemek için Transformer'ın doğasında bulunan özelliğinden yararlanıyoruz.

En yaygın yüz tanıma yaklaşımları, örneğin belirli nesneleri veya insanları tanımlayarak görüntülerde kalıp bulmayı otonom olarak öğrenebilen bir yapay sinir ağları (CNN) sınıfı olan CNN'lere dayanmaktadır. Bu yöntemlerden bazıları çok iyi performanslar elde ederken, son çalışmalar, görüntü dönüştürücüler (ViT'ler) olarak bilinen, yüz tanıma için başka bir algoritma sınıfının potansiyelini vurguladı.

Tipik olarak görüntüleri tamamen analiz eden CNN'lerin aksine, ViT'ler bir görüntüyü belirli bir boyuttaki parçalara böler ve ardından bu yamalara katıştırmalar ekler. Elde edilen vektör dizisi daha sonra standart bir transformatöre, analiz ettiği verilerin farklı kısımlarını farklı şekilde tartan bir derin öğrenme modeline beslenir.

Araştırmacılar makalelerinde, "CNN'lerin aksine ViT, aslında düzensiz ızgaralardan çıkarılan yamalar üzerinde çalışabilir ve kıvrımlar için kullanılan tek tip aralıklı örnekleme ızgarasına ihtiyaç duymaz." " İnsan yüzü , parçalardan (örn. gözler, burun, dudaklar) oluşan yapılandırılmış bir nesne olduğundan ve derin öğrenmeden önce parça tabanlı yüz tanıma konusundaki ufuk açıcı çalışmalardan ilham aldığından, ViT'yi yüz bölümlerini temsil eden yamalara uygulamayı öneriyoruz."

Sun ve Tzimiropoulos tarafından oluşturulan ve kısmen fViT olarak adlandırılan görüntü dönüştürücü mimarisi, hafif bir ağ ve bir görüntü dönüştürücüsünden oluşuyor. Ağ, yüzdeki yer işaretlerinin (örneğin burun, ağız vb.) koordinatlarını tahmin ederken, transformatör tahmin edilen yer işaretlerini içeren yamaları analiz eder.

Araştırmacılar, 93.431 kişinin görüntülerini içeren MS1MV3 ve 3.1 milyon görüntü ve 8.600 kimlik içeren VGGFace2 olmak üzere iki iyi bilinen veri setini kullanarak farklı yüz transformatörlerini eğitti. Ardından, modellerini değerlendirmek için bir dizi test gerçekleştirdiler ve bunun performanslarını nasıl etkilediğini test etmek için bazı özelliklerini değiştirdiler.

Mimarileri, üzerinde test edildiği tüm veri kümeleri için diğer birçok son teknoloji yüz tanıma modeliyle karşılaştırılabilir şekilde dikkate değer doğruluklar elde etti. Ek olarak, modelleri, bunun için özel olarak eğitilmeksizin yüz işaretlerini başarılı bir şekilde betimliyor gibi görünüyordu.

Gelecekte, bu son çalışma , görüntü dönüştürücülere dayalı diğer yüz tanıma modellerinin geliştirilmesine ilham verebilir. Ek olarak, araştırmacıların mimarisi, farklı yüz yer işaretlerinin seçici analizinden yararlanabilecek uygulamalara veya yazılım araçlarına uygulanabilir.

0 Yorumlar